DeepSeek, Mistral ve LLaMA gibi Büyük Dil Modelleri (LLM’ler) araştırma laboratuvarlarından gerçek dünyadaki uygulamalara geçti — sohbet botları, arama motorları, kişisel asistanlar ve kurumsal yapay zekâ araçlarını güçlendiriyor.

Ancak bu modelleri üretime almak tak-çalıştır bir işlem değildir. Özellikle LLM dağıtım stratejileri etrafında kritik mimari kararlar içerir.

Bu yazıda en yaygın LLM dağıtım yöntemlerini keşfedecek, yan yana karşılaştıracak ve görseller, gerçek kullanım senaryoları ve performans verileriyle hangisini ne zaman kullanmanız gerektiğine yardımcı olacağız.

Yapay zekâ ile oluşturuldu

Yapay zekâ ile oluşturuldu

1. İlk Soru: Bulut mu, Kendin Sun (Self-Hosted) mı?

Bir dağıtım yöntemi seçmeden önce şu soruyu yanıtlayın:

Barındırılan bir API’yi (bulut) mi kullanmak istiyorsunuz, yoksa modeli kendi altyapınızda mı çalıştıracaksınız (self-hosted)?

Bulut Tabanlı (OpenAI, Gemini, Anthropic vb.)

Artıları:- Kurulum gerektirmez

- Güncel, üst düzey modeller (GPT-4, Claude 3, Gemini Pro)

- Kolay ölçekleme, yönetilen servisler

- Kullanım başına ödeme (token bazlı fiyatlama)

- Veriniz üçüncü taraf sunuculara gider

- Sınırlı özelleştirme

En uygunu: MVP’ler, hızlı prototipler, sınırlı altyapıya sahip girişimler veya barındırma derdi olmadan en iyi modelleri kullanmanız gereken durumlar.

Kendin Sun (vLLM, Ollama, TGI)

Modeli kendi GPU sunucunuzda veya yerel makinenizde çalıştırırsınız.

Artıları:- Veri ve modeller üzerinde tam kontrol

- Ölçekte potansiyel olarak daha ucuz

- Çevrimdışı ve mahrem kullanım

- Güçlü donanım gerektirir (özellikle büyük modeller)

- Kurulum, bakım ve güncellemeler sizin sorumluluğunuzdadır

2. Temel Dağıtım Seçenekleri

🧠 vLLM (Virtual Large Language Model Server)

- Hugging Face uyumlu

- Performans için tasarlanmıştır (PagedAttention kullanır)

- GPT uyumlu API’ler (/chat/completions)

- Yüzlerce eşzamanlı isteği karşılayabilir

💻 Ollama

- Yerelde quantize modelleri çalıştırmak için CLI aracı

- GGUF formatını kullanır (CPU/GPU için verimli)

- Son derece hafif ve kurulumu çok hızlı

🌐 TGI (Text Generation Inference)

Yapay zekâ ile oluşturuldu

Yapay zekâ ile oluşturuldu

3. Uygulamalı Kullanım Örnekleri

Her dağıtım yöntemiyle hızlıca başlamanıza yardımcı olacak gerçek dünya komutları:

▶️ Ollama ile Mistral’ı Yerelde Çalıştırın

ollama run mistral

Ek kurulum gerektirmeden saniyeler içinde quantize bir Mistral modelini yerelde çalıştırır.

⚙️ vLLM ile GPT Uyumlu bir API Sunun

python -m vllm.entrypoints.openai.api_server \ --model facebook/opt-1.3b

vLLM ile yüksek performanslı, OpenAI tarzı bir API uç noktası başlatır (OPT 1.3B). /chat/completions ile uyumludur.

🐳 TGI ile Docker Üzerinden Mistral’ı Dağıtın

docker run -p 8080:80 \ ghcr.io/huggingface/text-generation-inference \ --model-id mistralai/Mistral-7B-Instruct-v0.1

Hugging Face’in TGI’si ile Mistral-7B-Instruct modelini servis etmeye hazır tam işlevli bir REST API oluşturur.

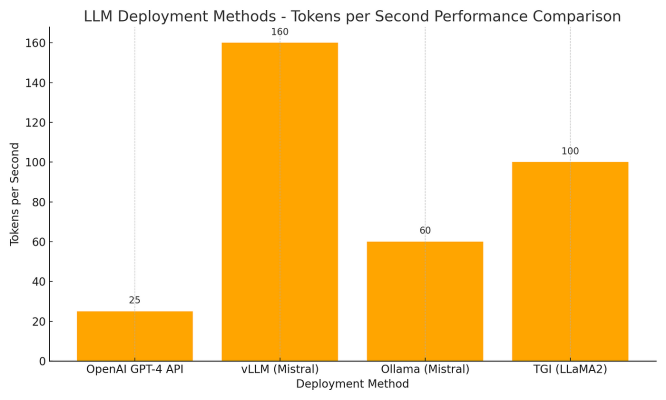

4. Performans Karşılaştırması: Saniye Başına Token

Farklı platformlar için ortalama token üretim hızı örneği:

🟢 vLLM aktarım hızında parlıyor 🟠 Ollama yerel kullanım için yeterince hızlı 🔵 OpenAI API ağ/API gecikmesi nedeniyle daha yavaştır ancak kullanım kolaylığı sunar

Yapay zekâ ile oluşturuldu

Yapay zekâ ile oluşturuldu

5. Bellek Kullanımı

Bu modelleri verimli çalıştırmak için gereken yerel bellek (RAM):

- OpenAI: 0 GB (bulutta çalışır)

- vLLM: 18 GB (7B+ modeller için uygun)

- Ollama: Hafif (7B GGUF için ~8 GB)

- TGI: Kuantizasyona bağlı olarak orta-yüksek

6. Maksimum Eşzamanlı İstek

Yoğun trafikli üretim sistemleri için kritiktir:

vLLM sektör seviyesinde ölçeklenebilirlik sunarken, Ollama kişisel uygulamalar veya düşük trafikli iç araçlar için idealdir.

7. Son Söz: Esneklik Anahtar

LLM dağıtımında herkese uyan tek bir yaklaşım yok.

👉 Basit bir uygulama kuruyorsanız, bir API yeterli olabilir. 👉 Trafiği ölçekliyorsanız, vLLM size binlerce dolar tasarruf ettirebilir. 👉 Tam gizlilik veya çevrimdışı kullanım istiyorsanız, Ollama harika bir seçimdir.

Kullanım senaryonuzu bilin. Maliyeti kontrol edin. Performansı optimize edin.

Söz Sizde 🚀

Hangi dağıtım yöntemini kullandınız? Neler işe yaradı, neler yaramadı?

Yorumlara düşüncelerinizi veya sorularınızı bırakın — deneyiminizi duymak isteriz!

Medium sayfası için buraya tıklayın.